Đầu năm nay, TikToker Julia Fox đã phải hứng chịu nước sôi lửa bỏng vì đã bình luận về một video TikTok khó hiểu.

TikToker Conor Whipple nói trong clip: “Đã tặng mascara cho một cô gái, và nó tuyệt đến mức cô ấy quyết định cùng bạn của cô ấy cùng thử mà không cần sự đồng ý của tôi”.

Fox bối rối trả lời: "Không hiểu tại sao nhưng tôi không cảm thấy buồn về điều đó". Fox không hề hay biết, thuật ngữ “mascara” được sử dụng thay thế cho việc tấn công tình dục trên mạng xã hội.

Người dùng TikTok sử dụng nó như một từ mã hóa để thảo luận về hành vi tấn công tình dục để lách luật kiểm duyệt nội dung nhạy cảm và tục tĩu. “Mascara” chỉ là một trong nhiều thuật ngữ được mã hóa bằng ngôn ngữ internet mới nổi gọi là “algospeak” (chỉ các thuật ngữ mà người dùng mạng xã hội sáng tạo để đánh lừa hệ thống kiểm duyệt nội dung tự động của AI).

Đó là một sự tò mò ngôn ngữ của thời đại kỹ thuật số. Đôi khi các thuật ngữ không liên quan như “mascara” hoàn toàn thay thế cho một từ khác.

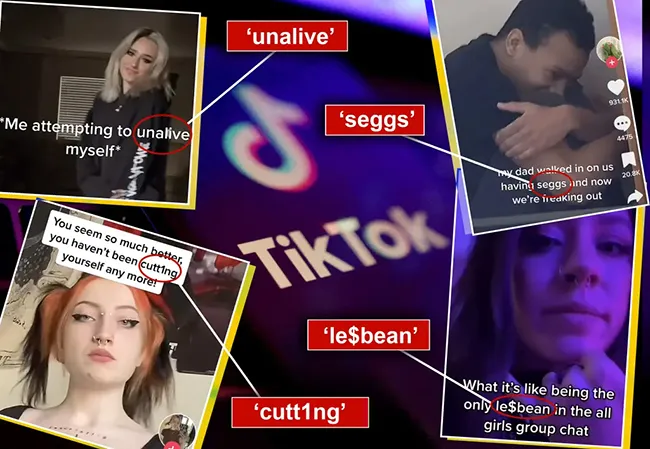

Để lách luật kiểm duyệt nội dung, đôi khi các thuật ngữ không liên quan như "mascara", "ana", các từ không có nghĩa nhưng có phát âm gần giống từ gốc như "seggs" (sex - tình dục) hay cutt1ing (cutting - cắt/tự hại), "unalive" (dead - chết) đã được tạo ra.

Mặc dù algospeak mang đến cho người dùng TikTok một cách để nói lên suy nghĩ của họ mà không sợ bị kiểm duyệt, nhưng nó cũng cho phép nội dung nguy hiểm tiềm tàng đang âm thầm được lan truyền.

Các từ mã Algospeak đang cho phép trẻ em truy cập nội dung về tự làm hại bản thân, tự tử và rối loạn ăn uống mà không cần các biện pháp bảo vệ trên mạng xã hội.

Theo chuyên gia AI Vince Lynch, hiện tượng này là không thể biết trước được và khó lường. Algospeak đặc biệt bắt nguồn từ TikTok, nơi việc kiểm duyệt nội dung diễn ra phổ biến.

Theo dữ liệu riêng của công ty, TikTok đã xóa 110 triệu video chỉ từ tháng 7 đến tháng 9 năm ngoái - khoảng 1% tổng số nội dung được đăng lên ứng dụng. Khoảng một nửa số video đã tự động bị xóa bởi trí thông minh nhân tạo phát hiện nội dung bị cấm.

Đó là lý do tại sao những người sáng tạo nội dung thông minh đã thay thế các từ, chẳng hạn như hoán đổi từ “kill” thành “unlive”. SeanVV, được xem là chuyên gia về các điều khoản dịch vụ và chính sách quyền riêng tư của Big Tech” đã tạo một danh sách dài sáu trang gồm các thẻ bắt đầu bằng # mà anh ấy tuyên bố là “bị cấm hoặc điều chỉnh” bởi thuật toán của TikTok.

Nhiều người đang mắc sai lầm khi sử dụng algospeak, ngay cả trong những ngữ cảnh có thể không cần thiết. Một loạt từ mã hóa mà người dùng cần lưu ý khi xem nội dung trên TikTok như: “Yt people” đã được sử dụng rộng rãi trong các video về người da trắng. “Le$bean” đôi khi thay thế đồng tính nữ trong các video. Và khi TikTok cố gắng trấn áp nội dung liên quan đến Covid-19, “panini” và “panoramic” đã trở thành từ thay thế cho từ “đại dịch”.

Khi nhắc đến chất cấm, những thuật ngữ như "snow" (tuyết) hay "skiing" (trượt tuyết) cũng là những từ được sử dụng rộng rãi. Theo một cuộc khảo sát do TELUS International thực hiện, 51% người dùng internet nói rằng họ đã nhận thấy cái gọi là “thuật ngữ” trực tuyến.

Trong số đó, thế hệ gen Z sử dụng ngôn ngữ mã hóa này tăng vọt lên tới 72%. Khoảng một phần ba Gen Z cho biết họ đã sử dụng ngôn ngữ internet mới lạ này. Nhưng algospeak có thể là một thứ thực sự nguy hiểm khi nó được sử dụng để phá vỡ một số quy tắc kiểm duyệt nội dung trên TikTok.

Theo nguyên tắc cộng đồng của TikTok, ứng dụng “không cho phép nội dung mô tả, quảng bá, chính thức hóa hoặc tôn vinh các hoạt động có thể dẫn đến tự tử, tự làm hại bản thân hoặc rối loạn ăn uống”.

Theo đó, những người dùng tìm kiếm từ khóa "tự tử" trên nền tảng này sẽ được chuyển hướng đến đường dây nóng hỗ trợ khủng hoảng tự tử. Và những người tìm kiếm "chán ăn" được cung cấp số điện thoại của Hiệp hội Rối loạn Ăn uống Quốc gia.

Nhưng những biện pháp đó chẳng có ý nghĩa gì khi các từ mã thuật toán phá vỡ chúng hoàn toàn. Đặc biệt, các cộng đồng nhỏ độc hại đã thống nhất sử dụng ngôn ngữ được mã hóa và khó hiểu này.

“Algospeak đang cho phép các nhóm đó tìm thấy nhau nhanh hơn, điều mà tôi nghĩ có thể thực sự nguy hiểm, đặc biệt là khi những người đó đang tìm kiếm thứ gì đó có hại cho chính họ,” Lynch cảnh báo.